A Survey of Reasoning and Agentic Systems in Time Series with Large Language Models

-

ArXiv URL: http://arxiv.org/abs/2509.11575v1

-

作者: Wen-Chih Peng; Tien-Fu Chen; Defu Cao; Haixin Wang; Jeehyun Hwang; Yan Liu; Yidan Shi; Ching Chang; Wei Yang; Wei Wang

-

发布机构: National Yang Ming Chiao Tung University; University of California; University of Southern California

引言

时间序列数据在金融、医疗、能源等领域无处不在,推动了监控、预测和决策等关键应用的发展。然而,许多新兴应用如个性化医疗、自适应风险管理等,要求模型不仅能预测,还能解释其输出、进行因果推理和决策。这突显了时间序列分析对结构化和可靠推理能力的迫切需求。

大型语言模型(LLMs)的出现是一个转折点。它们能够展现逐步推理、阐明因果假设,并与外部工具和环境交互。当被整合到智能体(Agent)系统中时,LLMs获得了规划、反思和持续适应的能力,将时间序列建模从静态预测转变为交互式和解释性的过程。

基于此,本文将时间序列推理(Time Series Reasoning, TSR)定义为:大型语言模型在处理带时间索引的数据时,显式执行结构化推理程序的一类方法,这些方法可能通过多模态上下文和智能体系统得到增强。本文的核心贡献在于:

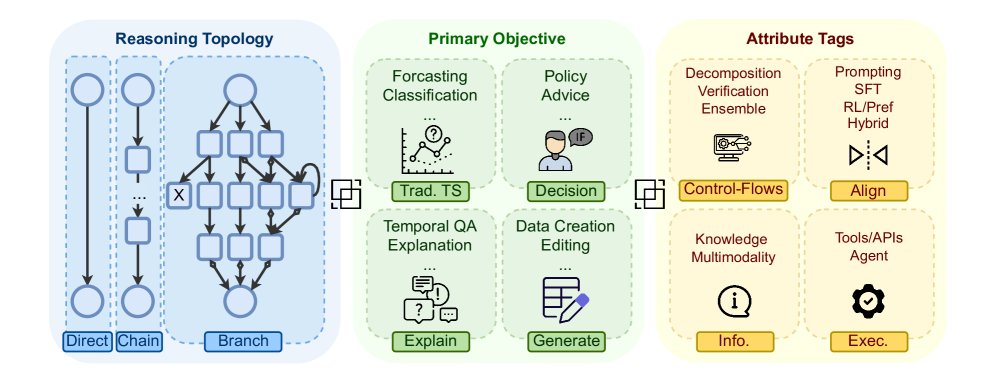

- 提出首个系统性分类体系:围绕推理拓扑(执行结构)和主要目标(任务意图)两个互补的轴线构建,并辅以描述控制流、执行者、模态、知识访问和LLM对齐方案的属性标签。

- 提供综合性回顾:不仅分析了研究论文中的方法模式,还对数据集、基准、综述等辅助性工作进行了分类,展示了它们如何支持和塑造时间序列推理领域的发展。

- 明确开放性问题:重点指出了在评估、多模态融合、知识增强、长上下文推理、效率、智能体控制以及因果推断等方面的挑战,为该领域的下一阶段研究规划了蓝图。

背景与分类体系

时间序列推理的定义

时间序列推理 (Time Series Reasoning, TSR) 指的是在处理带时间索引的数据时执行显式推理程序的方法。这些方法越来越多地由大型语言模型(LLMs)和多模态LLMs实现,它们能够清晰地表达推理轨迹、与外部工具交互,并作为自主智能体运行。

本文提出的分类体系包含三个互补的组成部分:

- 推理拓扑 (Reasoning Topology):指定推理的执行结构。

- 主要目标 (Primary Objective):阐明推理过程的主要意图。

- 属性标签 (Attribute Tags):描述如控制流、执行者、模态和对齐等辅助属性。

其中,推理拓扑和主要目标是互斥的:每篇论文根据其核心结构和评估重点,被精确分配一个拓扑和一个目标。相比之下,属性标签是非互斥的,一篇论文可以同时拥有多个标签。

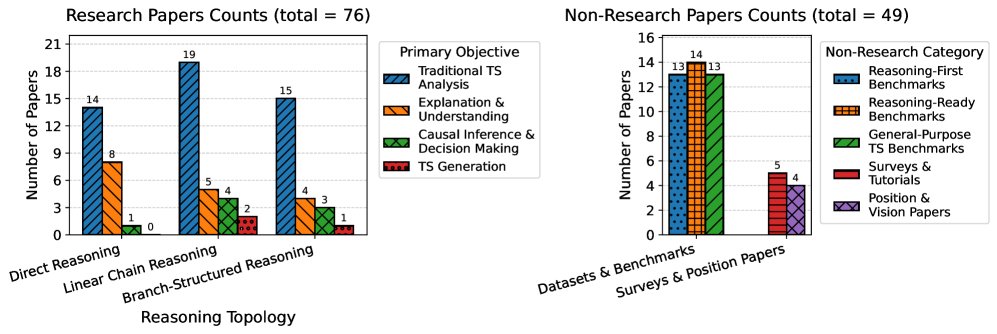

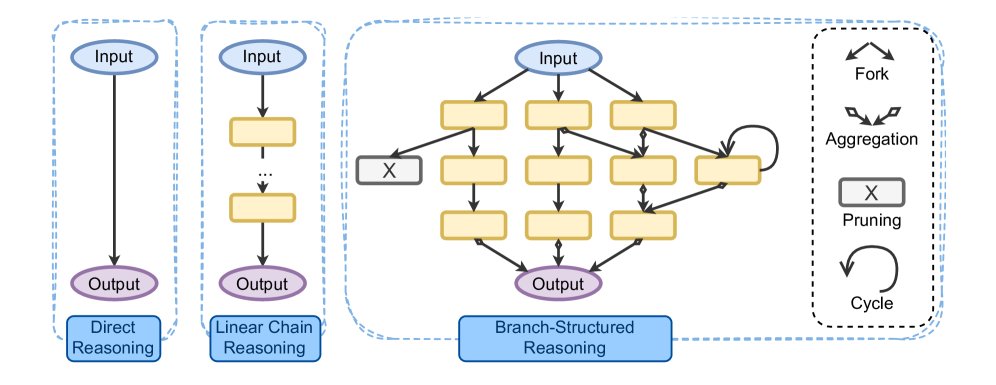

推理拓扑

本文识别出三种互斥的推理拓扑,它们代表了从简单到复杂的推理复杂度谱系:直接推理、线性链式推理和分支结构推理。

直接推理 (Direct Reasoning)

这是最简单的执行形式:单步推理或工具调用,没有任何中间推理轨迹。模型直接从输入跳到输出,例如直接生成预测或分类标签。这种方式效率最高,但可解释性、鲁棒性和处理复杂任务的能力有限,通常作为基线或在对透明度要求不高的场景中使用。

线性链式推理 (Linear Chain Reasoning)

通过引入一系列顺序排列的推理步骤来扩展直接推理。每一步都依赖于前一步的输出,形成一个逻辑进程(例如,分步预测)。这种结构使中间状态变得明确、可观察,从而提供了比直接推理更好的可解释性和模块化。然而,它仅限于单一路径,缺乏探索多重假设的灵活性。

分支结构推理 (Branch-Structured Reasoning)

在这种拓扑中,推理轨迹可以在单次执行中分支成多个路径。分支可能源于模型并行或顺序地探索不同的假设、计划或解释。这使得系统能够进行探索、自适应修正早期步骤、重用中间结果,甚至通过反馈循环或跨分支操作来整合信息。与线性链式推理相比,它更为灵活和强大,但也带来了控制分支增长、处理反馈循环等挑战。

主要目标

主要目标定义了推理过程的最终目的。本文将目标分为四大类,这为比较方法提供了另一个维度:不仅看它们“如何”推理,也看它们“为何”推理。

传统时间序列分析

涵盖直接建模时间动态的预测性和描述性任务,是时间序列推理的基础。

- 预测 (Forecasting):将预测视为一个显式的推理过程,而不仅仅是数值外推。

- 分类 (Classification):通过结构化提示或逐步推理将时间序列映射到语义类别。

- 异常检测 (Anomaly Detection):利用推理来判断异常点,例如通过对比候选解释。

- 分割 (Segmentation):结合统计线索与可解释规则来划分序列。

- 多任务 (Multiple Tasks):统一的推理框架同时处理多个目标。

解释与理解

强调生成人类可解释的见解,而非原始预测。

- 时间序列问答 (Temporal Question Answering):解析关于时间信号的问题,并提供基于证据的答案。

- 解释性诊断 (Explanatory Diagnostics):连接观察到的结果与根本原因,生成诊断性叙述。

- 结构发现 (Structure Discovery):生成并提炼描述时间序列依赖关系的解释性结构,如因果元组或符号规则。

因果推断与决策

关注于在时间环境中对干预及其结果进行推理。

- 自主策略学习 (Autonomous Policy Learning):模型直接从时间状态中推导和执行动作策略。

- 辅助决策支持 (Advisory Decision Support):系统提供有理有据的建议或“假设”分析,以协助人类决策者。

时间序列生成

关注直接创建或修改时间数据。

- 条件化合成 (Conditioned Synthesis):将提示或规范映射为时间动态,确保合成序列遵循预期的模式。

属性标签

属性标签是用于捕获额外属性的轻量级、非互斥描述符,分为四类。

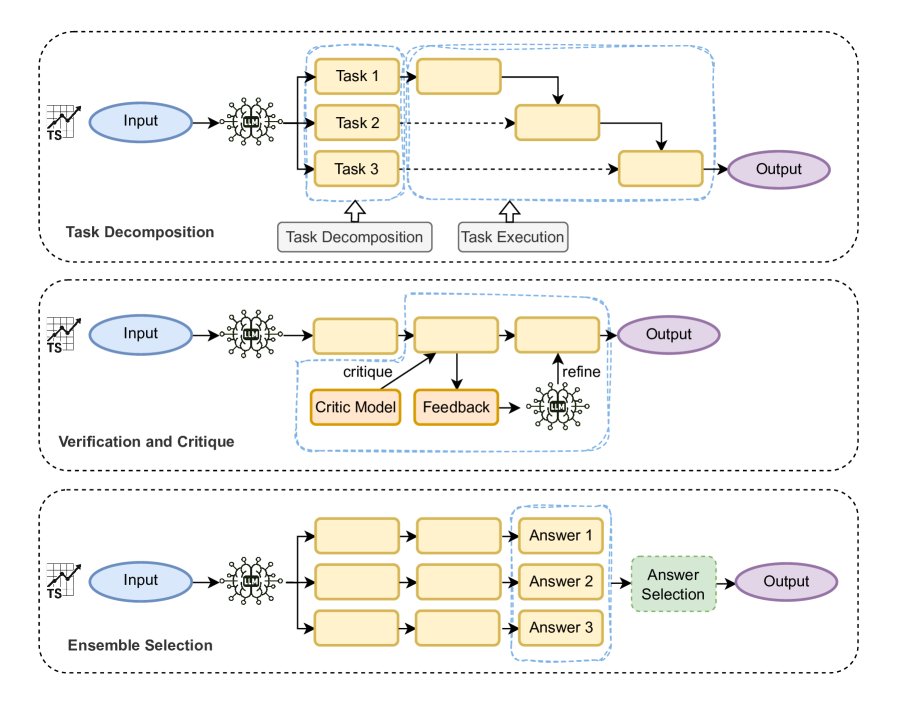

控制流操作符

描述推理过程在步骤间的组织方式。

- 任务分解 (Task Decomposition):显式地将问题分解为子问题或子计划。

- 验证与批判 (Verification and Critique):存在一个明确的步骤来评估候选输出或中间推理。

- 集成选择 (Ensemble Selection):显式比较多个候选推理轨迹或预测,并根据规则(如投票、排序)选择最终结果。

执行智能体

指明在执行过程中负责执行推理步骤的实体。

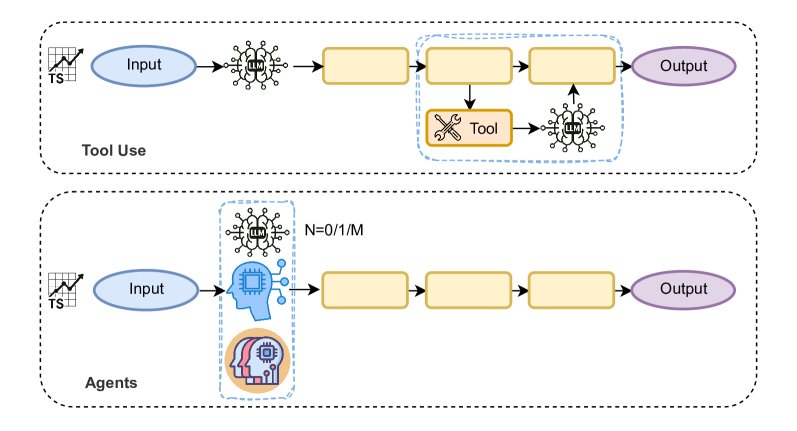

- 工具使用 (Tool Use):模型在推理过程中调用外部资源,如搜索引擎或求解器。

- 智能体 (Agents):这是一个分类标签,记录推理时是否存在自主智能体(0=无,1=单个,M=多个协作)。

信息源

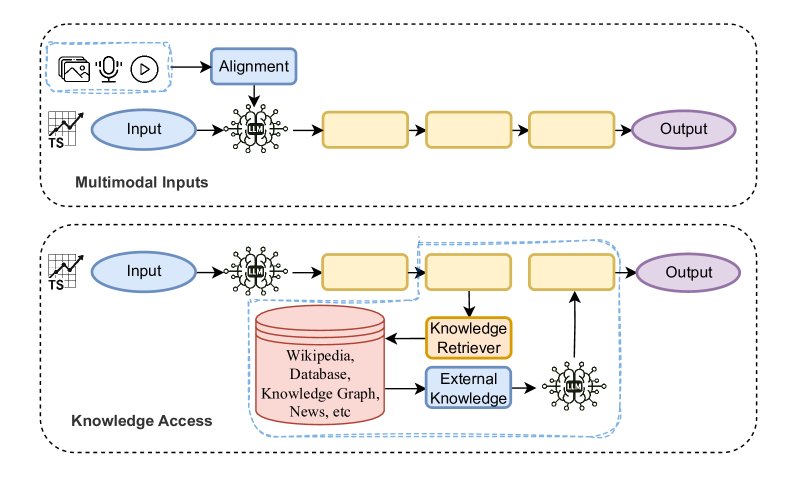

捕获超出原始时间序列本身的输入。

- 多模态输入 (Multimodal Inputs):将时间序列与其他模态(如自然语言、图像)结合。

- 知识访问 (Knowledge Access):通过检索模块、搜索引擎或数据库等方式整合外部信息。

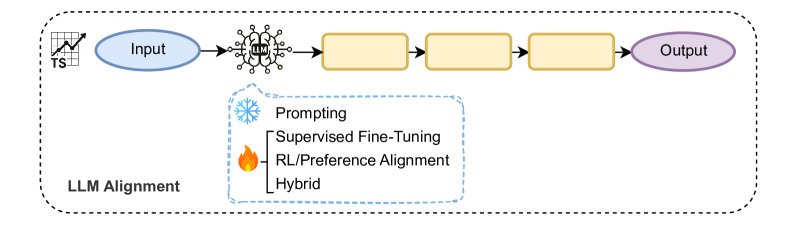

LLM对齐机制

指定LLM如何被训练或调整以在时间序列任务上执行推理。这是一个分类标签,包含四种机制:

- 提示 (Prompting):使用冻结模型,通过指令或少量示例进行引导。

- 监督微调 (Supervised fine-tuning):在有标签的时间序列推理任务上训练模型。

- 强化或偏好对齐 (Reinforcement or preference alignment):使用基于反馈的目标(如RLHF)来调整模型。

- 混合方法 (Hybrid approaches):结合监督微调和强化/偏好对齐。

直接推理

直接推理是分类体系中最基本的推理拓扑。在此设置中,模型在单一步骤内将时间序列输入直接映射到输出,而不生成或暴露任何中间推理轨迹。这种方法虽然简单高效,但在可解释性和处理复杂任务方面能力有限。尽管如此,它在近期工作中仍被广泛采用,尤其是在直接的预测、异常检测或描述性问答任务中。

以下是直接推理方法按其主要目标的组织:

- 传统时间序列分析

- 预测:

- LLMTIME [Gruver et al. (2023)], CiK [Williams et al. (2025)], DP-GPT4MTS [Liu et al. (2025a)], TEMPO [Cao et al. (2024a)], NNCL-TLLM [Bogahawatte et al. (2024)], CMLLM [Zhu et al. (2025)], Hybrid-MMF [Kim et al. (2024)], Tang et al. (2025)

- 分类:

- HiTime [Tao et al. (2024)], HeLM [Belyaeva et al. (2023)], FinSrag [Xiao et al. (2025a)]

- 异常检测:

- Zhou & Yu (2025)

- 分割:

- MedTsLLM [Chan et al. (2024)]

- 多任务:

- ChatTime [Wang et al. (2025a)]

- 预测:

- 解释与理解

- 时间序列问答:

- Chat-TS [Quinlan et al. (2025)], ChatTS [Xie et al. (2025)], ITFormer [wang et al. (2025)], Time-MQA [Kong et al. (2025a)]

- 解释性诊断:

- GEM [Lan et al. (2025)], Time-RA [Yang et al. (2025b)], Momentor [Qian et al. (2024)]

- 结构发现:

- RealTCD [Li et al. (2024b)]

- 时间序列问答:

- 因果推断与决策

- 自主策略学习:

- GG-LLM [Graule & Isler (2024)]

- 自主策略学习:

传统时间序列分析与直接推理

在这类任务中,模型充当一个单步映射器,将时间输入(可带有附加上下文)转换为预测、类别标签或异常区间等输出。

预测

- LLMTIME: 将预测问题重构为对文本化数字的下一Token生成。

- CiK: 在一个上下辅助的基准上评估直接提示,以结构化形式一次性输出概率预测。

- TEMPO: 将趋势、季节性和残差分解,用特定提示预测各分量,最后相加得到预测结果。

- NNCL-TLLM: 通过最近邻选择学习到的提示,输入到部分调整的LLM中生成预测。

分类

- HiTime: 对齐时间序列和文本语义,让微调后的LLM以文本形式生成类别标签。

- FinSrag: 检索历史指标片段,序列化后用于提示,让一个微调的LLM直接预测股票涨跌。

异常检测

- Zhou & Yu (2025): 提示LLM从文本化序列或绘图图像中一步返回异常区间,发现图像输入通常优于文本输入。

分割

- MedTsLLM (2024): 将上下文文本和信号片段(如ECG)连接到冻结的LLM中,通过线性投影输出嵌入来生成分割掩码或边界点。

解释与理解与直接推理

这类方法的主要产物是自然语言答案、基本原理或因果解释,它们都是通过单步推理从时间序列中派生出来的。

时间序列问答

- Chat-TS: 扩展LLM词汇表以包含离散的时间序列Tokens,并在多模态指令数据集上训练,以实现混合时间序列-文本的直接问答。

- ChatTS: 开发了一个多模态LLM,通过合成QA生成和分阶段微调来整合时间序列和文本,支持对趋势、季节性、异常和因果查询进行单步解释性推理。

解释性诊断

- GEM: 对齐ECG波形、图像和文本,通过微调LLM,可以生成带有临床医生风格解释的诊断报告。

- Time-RA: 引入了一个以推理为中心的大型多模态异常检测数据集RATs40K,模型可在单次传递中生成“观察-思考-行动”式的基本原理。

因果推断与决策与直接推理

自主策略学习

- GG-LLM: 提出了一个面向人类感知的机器人任务规划框架,其中一个冻结的LLM在一次提示后对候选交互进行评分,下游规划器使用这些分数来引导机器人,从而减少对人类的干扰。

直接推理中的属性标签

- 控制流操作符: 任务分解、验证和集成选择在直接推理中很少被采用。

- 执行智能体: 工具使用几乎不存在,且所有流程都以非智能体方式运行。

- 信息源: 多模态输入相当普遍,例如将时间序列与文本、图像或视频结合。知识访问则几乎不存在。

- LLM对齐机制: 仅提示和监督微调都被广泛采用。没有出现仅强化学习或混合对齐的机制。

线性链式推理

线性链式推理表示执行过程遵循一个单一、有序的步骤序列,并且在轨迹中没有分支。模型可以显式分解任务、调用一次工具或检索,并可选地执行一次性的验证,但它不会维护多个并发的假设或进行“批判-修正”的迭代循环。这种拓扑结构在保留直接推理大部分简单性的同时,增加了一些温和的结构,可以改善基础和数值稳定性,同时仍然避免了分支结构系统的延迟和复杂性。

以下是线性链式方法按其主要目标的组织:

- 传统时间序列分析

- 预测:

- TimeReasoner [Wang et al. (2025c)], RAF [Tire et al. (2024)], TimeRAG [Yang et al. (2024)], Time-R1 [Luo et al. (2025)], Yu et al. (2023)

- 分类:

- TableTime [Wang et al. (2025d)], VL-Time [Liu et al. (2025c)], ZARA [Li et al. (2025e)], TimeMaster [Zhang et al. (2025b)], Chow et al. (2024), REALM [Zhu et al. (2024)]

- 异常检测:

- VLM4TS [He et al. (2025)], LLMAD [Liu et al. (2025e)], Dong et al. (2024), SIGLLM [Alnegheimish et al. (2024)], SLEP [Wang et al. (2026)], LEMAD [Ji et al. (2025)]

- 多任务:

- LTM [Hao et al. (2025)], Ravuru et al. (2024)

- 预测:

- 解释与理解

- 时间序列问答:

- Tan et al. (2025), TG-LLM [Xiong et al. (2024)]

- 解释性诊断:

- TempoGPT [Zhang et al. (2025a)], TSLM [Trabelsi et al. (2025)], Xu et al. (2025a)

- 时间序列问答:

- 因果推断与决策

- 自主策略学习:

- FinAgent [Zhang et al. (2024a)], FINMEM [Li et al. (2024a)], Open-TI [Da et al. (2024)]

- 辅助决策支持:

- SocioDojo [Cheng & Chin (2024)]

- 自主策略学习:

- 时间序列生成

- 条件化合成:

- GenG [Zhou et al. (2024)], Joshi (2025)

- 条件化合成:

传统时间序列分析与线性链式推理

在线性链式推理下进行传统的时间序列分析,通常会实现一个脚本化的序列,如“分析 → (检索) → 预测”或“检测 → 验证 → 决策”,同时保持单一路径执行。

预测

- TimeReasoner: 将时间序列预测视为一个深思熟虑的推理过程,使用结构化提示让LLMs在生成预测之前先分析模式,这是一个固定的线性序列。

- RAF: 引入一个检索增强框架,为数据集构建特定数据库,检索最相关的时间片段,并将其整合到预测过程中。

- TimeRAG: 提出一种基于检索的方法,将时间序列切片成代表性片段,检索相似历史,并将其重编程为自然语言提示,供冻结的LLM使用。

分类

- TableTime: 将时间序列序列化为表格形式的提示,用于无需训练的分类,采用固定的“分析后分类”流程,并可选择跨多个独立运行进行自洽集成。