A Survey of Reasoning in Autonomous Driving Systems: Open Challenges and Emerging Paradigms

自动驾驶的“认知”革命:大模型如何攻克7大核心推理挑战?

自动驾驶汽车已经从科幻驶入现实,但为何它们在面对人类司机看来“常识性”的复杂路况时,仍会显得犹豫甚至犯错?当感知能力不再是唯一瓶颈,真正的挑战已经悄然转向一个更深层次的问题:推理能力的缺失。

ArXiv URL:http://arxiv.org/abs/2603.11093v1

最近,来自华东师范大学、香港大学和清华大学的学者联合发表了一篇综述,系统性地探讨了自动驾驶领域的这一核心难题。该研究旗帜鲜明地指出,我们不应再将推理视为一个独立的模块,而应将其提升为整个自动驾驶系统的认知核心。更令人兴奋的是,以LLM和MLLM为代表的大模型,正为这场“认知”革命带来了前所未有的机遇。

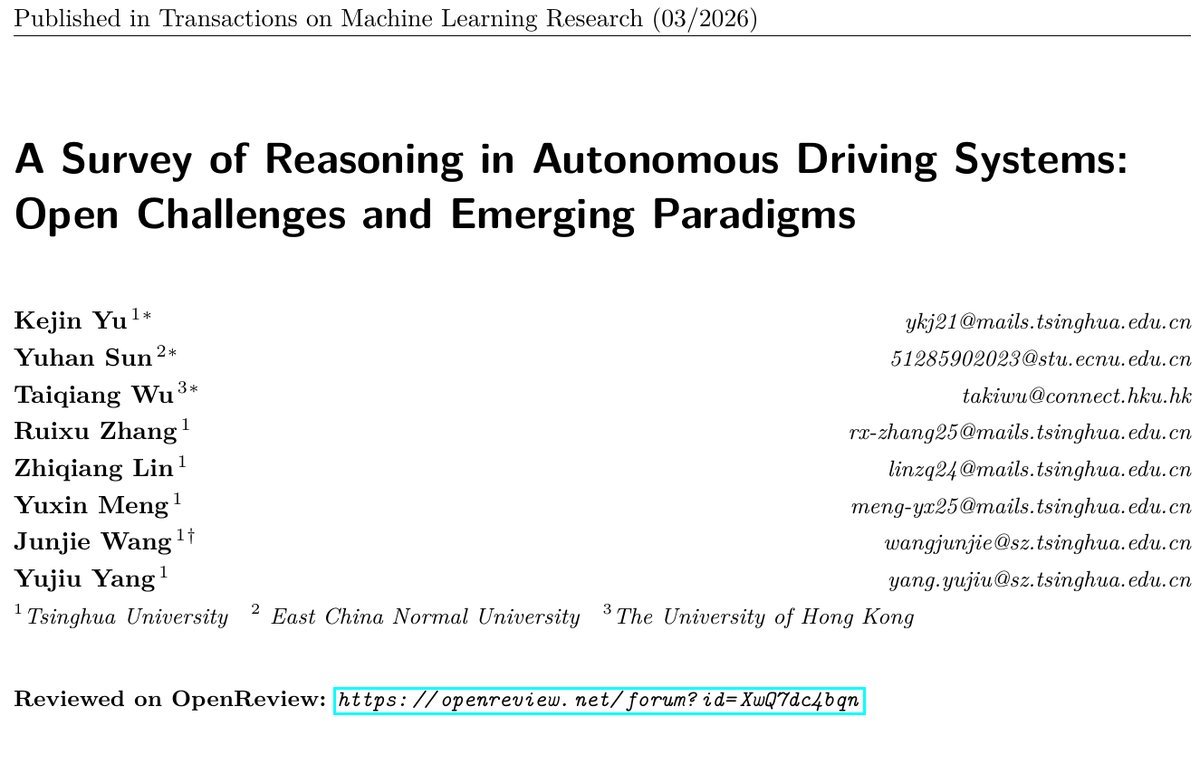

图1:显式推理为何至关重要。左侧为7大推理挑战,右侧展示了缺乏推理的系统(红色决策)与具备推理能力的系统(绿色决策)在处理突发状况时的巨大差异。

从模块化到认知核心:自动驾驶的新范式

传统的自动驾驶系统大多采用“感知-预测-规划-控制”的模块化流水线。这种架构在标准路况下表现尚可,但其弊端也十分明显:模块间的信息损耗、对预设规则的过度依赖,以及在面对不确定性时的脆弱性。

这就像一个团队,每个成员都很专业,但彼此沟通不畅,导致整体决策效率低下。

该研究提出,是时候改变这种模式了。大模型强大的语言和多模态理解能力,使其能够扮演一个认知核心的角色。它不再是简单的符号推理,而是通过语言中介进行学习和深思熟虑,从而协调各个模块,解决复杂场景下的规则冲突与交互难题。

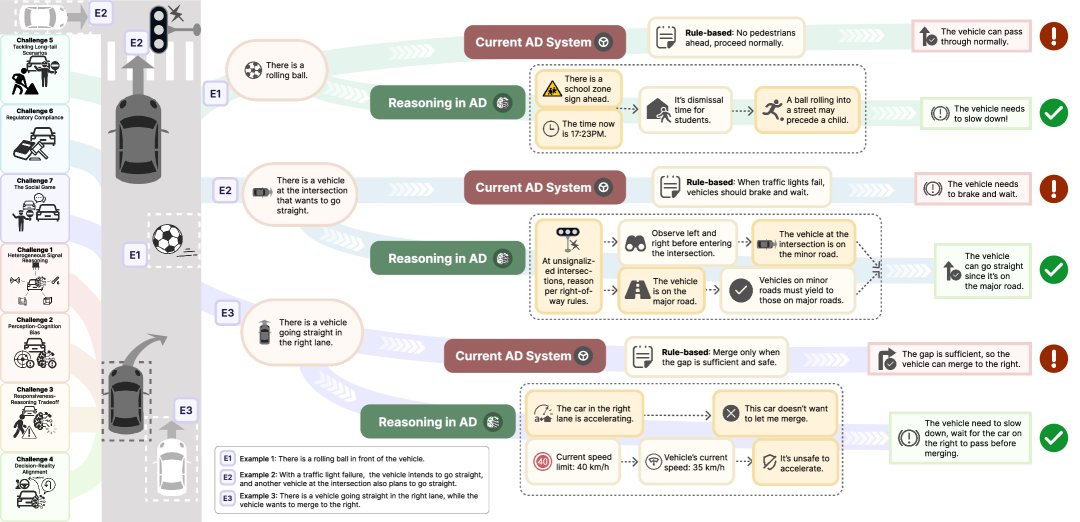

解构驾驶任务:全新的三层认知层次

为了精准地分析和解决问题,研究者首先提出了一个全新的认知层次(Cognitive Hierarchy)框架,将“驾驶”这一宏大任务,按认知和交互的复杂性,分解为三个层次。

图2:驾驶任务的三层认知层次框架

-

感知运动层 (Sensorimotor Level):这是最基础的层面,负责车辆与环境的直接交互,如执行转向、加速、刹车等原子操作。它需要最少的复杂决策。

-

自我中心推理层 (Egocentric Reasoning Level):车辆开始从自身视角出发,处理与周围其他交通参与者的直接互动。例如,在自动泊车时,系统需要整合多源感知信息,规划出一系列连贯动作。

-

社会认知层 (Social-Cognitive Level):这是实现完全自动驾驶的终极挑战。系统必须像人类司机一样,理解社会常识、交通法规,甚至预测他人的意图。这要求车辆成为交通环境中一个具备“社交意识”的参与者。

目前,L2/L3级别的自动驾驶主要在第一和第二层级运行。而通往L4及更高级别自动驾驶的最大障碍,正是尚未被充分解决的社会认知层。

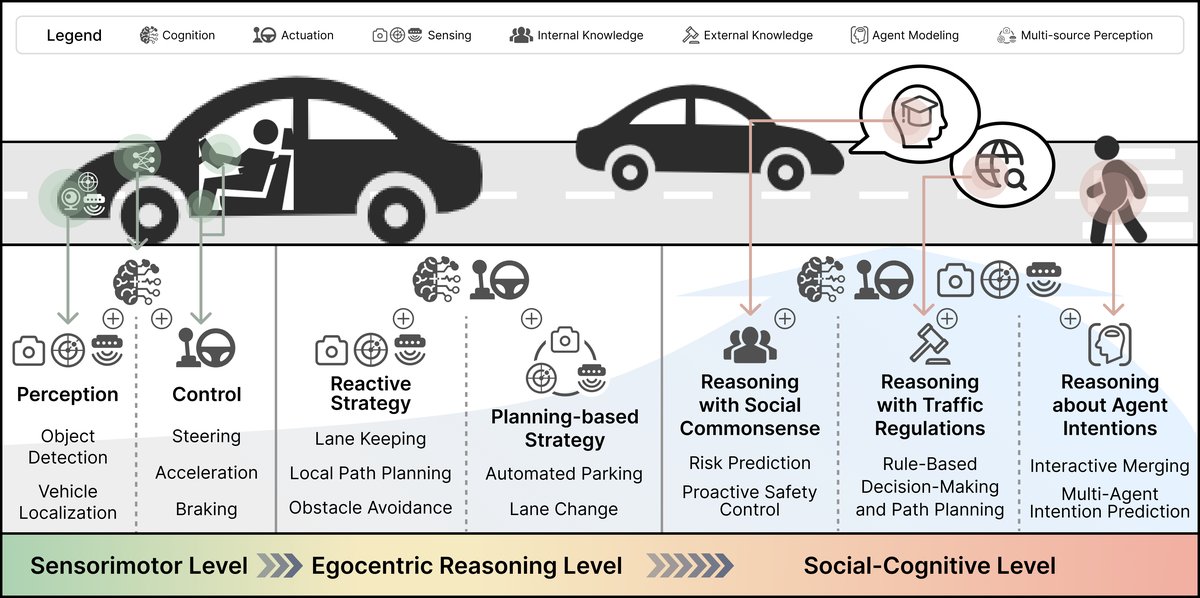

七大核心推理挑战

基于上述认知层次,该研究进一步梳理出阻碍大模型在自动驾驶中落地的七大核心推理挑战。这些挑战清晰地勾勒出了未来研究需要攻克的版图。

图3:七大核心推理挑战分类及场景图示

挑战 #1:异构信号推理 (Heterogeneous Signal Reasoning)

自动驾驶系统需要融合摄像头、LiDAR、雷达、高清地图等多种异构数据流。挑战在于如何将这些信息整合成一个连贯的环境表征,以支持“蓝色货车左后方”这类复杂的空间关系推理。

挑战 #2:感知-认知偏差 (Perception-Cognition Bias)

系统的可靠性同时受到两类不确定性的威胁:一是恶劣天气、传感器故障等外部因素导致的感知不准;二是模型“幻觉”等内部因素导致的认知错误。推理核心必须具备交叉验证和事实核查的能力,以过滤掉不存在的“幽灵红绿灯”。

挑战 #3:响应-推理权衡 (Responsiveness-Reasoning Tradeoff)

这是一个根本性的矛盾。自动驾驶要求毫秒级的实时响应,而大模型的深度推理却非常耗时。如何在“快思考”(即时反应)和“慢思考”(深思熟虑)之间动态切换,是架构设计的关键。尤其是在高速并线等场景,既要快速决策,又要深思熟虑。

挑战 #4:决策-现实对齐 (Decision-Reality Alignment)

“向右变道避障”——这个来自大模型的决策听起来很完美,但物理上可行吗?推理系统必须确保高层语义决策符合车辆的动力学限制和环境的几何约束,避免规划出无法执行的“空中楼阁”轨迹。

挑战 #5:应对长尾场景 (Tackling Long-tail Scenarios)

数据驱动的方法在罕见场景(如临时施工区、极端天气)面前常常失灵。解决长尾问题的关键不在于收集更多数据,而在于赋予系统强大的推理能力,使其能够在没有直接经验的情况下,依据常识和原则做出正确判断。例如,当交警手势与红绿灯冲突时,系统需要推理出指令的优先级(人类指挥官 > 交通信号灯)。

挑战 #6:法规遵从性 (Regulatory Compliance)

自动驾驶必须遵守复杂且动态变化的交通法规。这不仅涉及对成千上万条法律条文的理解,还包括各地不同的地方法规和不成文的驾驶习惯。系统需要具备检索、解释和在冲突中权衡适用规则的能力。

挑战 #7:社交博弈 (The Social Game)

在混合交通中,自动驾驶汽车不能只是一个守法机器,更要是一个“社交达人”。它需要通过观察其他车辆的微小动态(如速度、轨迹变化),来推断其意图,进行默契的“非语言沟通”和博弈。例如,在并线时判断对方是否会让你。

结论与展望

这篇综述清晰地指出了自动驾驶领域从“感知为王”到“认知为核”的范式转变。大模型为解决推理赤字带来了曙光,但也带来了新的挑战,其中最核心的便是LLM高延迟的深思熟虑特性与自动驾驶毫秒级安全需求的根本矛盾。

未来的研究重心将聚焦于弥合符号世界与物理世界之间的鸿沟。这包括开发可验证的神经符号架构、研究不确定性下的鲁棒推理,以及为含蓄的社交博弈建立可扩展的模型。

总而言之,让自动驾驶汽车学会“思考”,特别是像人一样进行社会化思考,将是通往真正智能交通的必由之路。这场认知革命,才刚刚开始。