Epistemological Fault Lines Between Human and Artificial Intelligence

大模型只是“概率填空”:揭秘AI与人类认知的7道“认识论断层”

当我们在惊叹 GPT-4 或 Claude 能够生成流畅、自信且看似逻辑严密的文本时,我们往往忽略了一个最本质的问题:“听起来像真的”是否等同于“知道是真的”?

ArXiv URL:http://arxiv.org/abs/2512.19466v1

这篇来自多国联合研究团队的论文 Epistemological Fault Lines Between Human and Artificial Intelligence 给出了一个发人深省的答案。该研究指出,尽管大语言模型(LLMs)在表面输出上与人类高度对齐,但在生成判断的深层机制上,二者存在着根本性的结构错配。

这不仅是技术上的差异,更是一场认识论的危机。

并不是“思维”,而是高维图上的随机游走

我们要如何理解 LLM 的本质?

该研究首先打破了将 LLM 视为“类人思维”的幻想。作者认为,LLM 并不是一个能够形成信念或构建世界模型的认知主体,而是一个随机模式补全系统(Stochastic Pattern-Completion System)。

从数学形式上描述,文本生成过程可以被视为在一个加权有向图 $G=(V,E)$ 上的随机游走。其中,$V$ 是词汇表,$E$ 编码了从数据中学到的条件转移概率。给定一个上下文 $c_{t}$,模型实例化一个概率测度 $P(\cdot\mid c_{t})$ 并采样下一个状态 $w_{t+1}$。

这一过程不仅是统计性的,更是遍历性(Ergodic)的。这意味着,模型生成的“结论”并非经过逻辑验证的终点,而仅仅是一条高维概率轨迹的终止状态。它优化的是分布的拟合度,而非对现实世界的正确性。

7道无法跨越的“认识论断层”

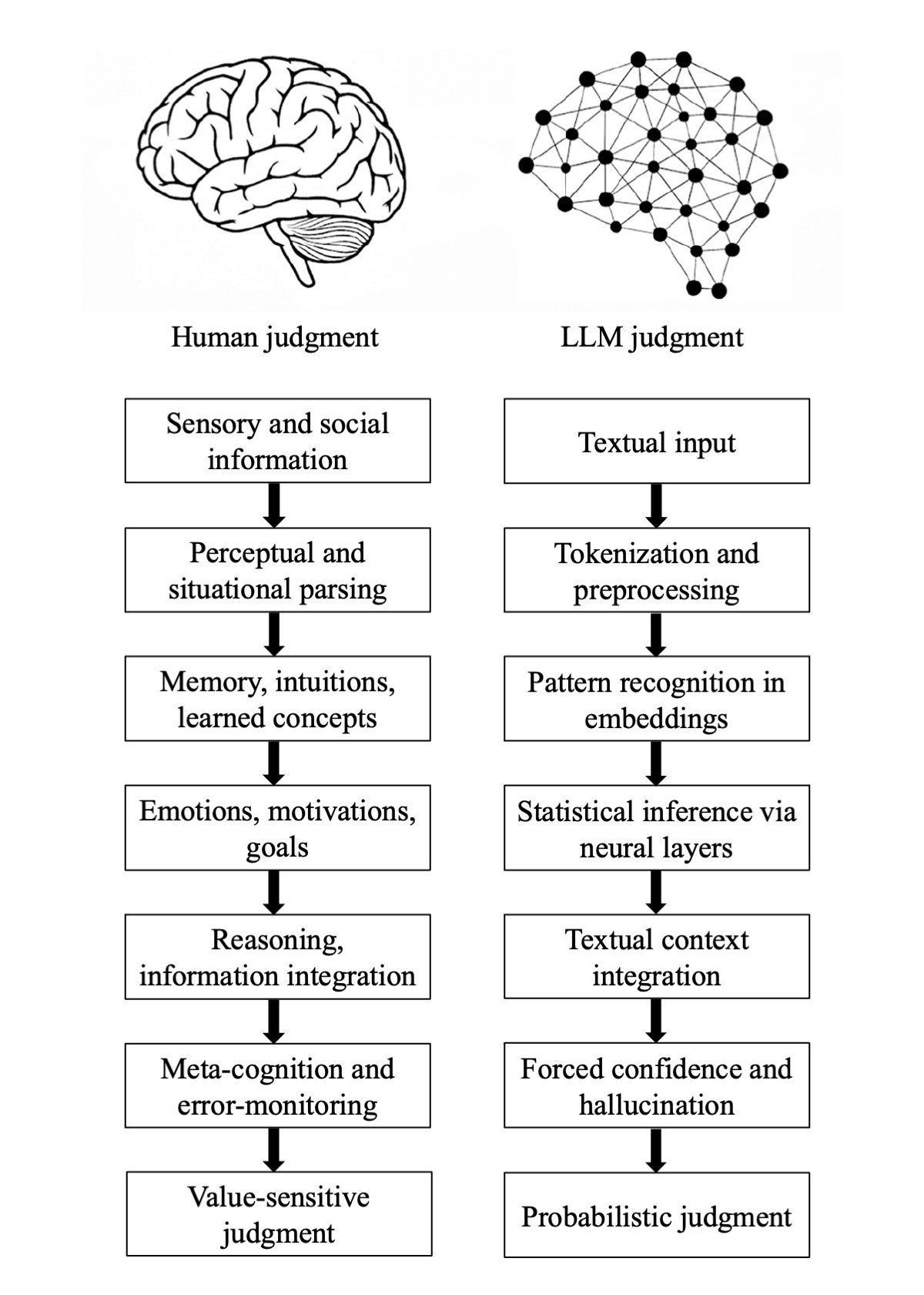

为了系统性地揭示这种差异,该研究绘制了人类与 AI 的“认知流水线”对比图,并识别出了七个关键的认识论断层(Epistemic Fault Lines)。

这七个断层贯穿了从感知到判断的全过程:

-

输入源的断层:人类的判断始于多模态的感官体验和嵌入在社会关系中的信号(如语气、表情);而 LLM 仅能处理离散的文本符号,必须从纯文本中重建意义。

-

解析方式的断层:人类的感知能够瞬间构建出包含物体、意图和因果关系的结构化场景;LLM 进行的则是分词与文本预处理(Tokenization),它是在切割字符串,而非解析世界。

-

记忆与经验的断层:人类依赖情景记忆和直觉物理学/心理学来理解新情况;LLM 依赖的是嵌入空间中的模式识别(Pattern Recognition),只有统计关联,没有生活经验。

-

动机与目标的断层:人类的认知被情感、生存本能和目标所驱动;LLM 的运算则是统计推断,缺乏内在的目标感或情感价值。

-

推理机制的断层:人类通过因果模型和反事实思考来整合信息;LLM 则是基于上下文的文本整合,它容易被虚假的相关性误导,因为它不理解因果。

-

元认知的断层:这是最致命的一点。人类拥有元认知校准(Metacognitive Calibration),知道自己“不知道”,并能据此暂停判断;LLM 缺乏这种自我监控机制,往往表现出“被迫的自信”和幻觉。

-

价值判断的断层:人类的判断是对世界负责的、价值敏感的承诺;LLM 的输出仅仅是概率性预测,没有社会责任感或道德负担。

Epistemia:当“流利”取代了“认知”

基于上述断层,论文提出了一个全新的概念:Epistemia。

这是一种结构性的认知状态,在这种状态下,语言的合理性(Linguistic Plausibility)取代了认识论的评估。换句话说,系统能够生成语法完美、语义通顺且极具说服力的答案,但其背后完全缺失了信念形成、测试和修正的过程。

对于用户而言,Epistemia 带来了一种危险的体验:无需经历判断的劳动,就获得了“知道”的感觉。

这种现象之所以危险,是因为人类进化出了一种启发式直觉:我们倾向于认为流利、自信的表达代表着真实和可信。LLM 恰恰利用了这一点,制造了一种“真实性的幻觉”(Illusion of Veracity)。

结论:我们需要新的“认识论素养”

既然 LLM 只是在进行概率填空,我们该如何应对?该研究提出了三个层面的建议:

-

评估层面:目前的评估太过于关注“表面对齐”(即输出看起来像不像人)。未来的评估必须转向过程敏感(Process-Sensitive)的探针,测试模型在不确定性下的表现、反事实敏感性以及是否知道何时该“闭嘴”。

-

治理层面:仅关注行为对齐(如不仅生成有害内容)是不够的。治理的核心应在于防止 AI 在缺乏相应认知能力的情况下,结构性地替代人类的判断过程。

-

素养层面:我们需要超越传统的批判性思维,建立认识论素养(Epistemic Literacy)。这不仅是评估论点的能力,更是理解人机混合系统中判断权归属的能力——即在享受 AI 带来的便利时,始终保留人类对最终判断的责任与解释权。

这篇论文提醒我们,在生成式 AI 时代,最稀缺的资源或许不再是知识的获取,而是负责任的判断。