LLM-in-Sandbox Elicits General Agentic Intelligence

给大模型配台“电脑”:通用智能涌现,长文本Token消耗暴降8倍

如果说大模型(LLM)是拥有超级大脑的智者,那么现在的 Agent 框架往往像是给这位智者配备了特定的“拐杖”——专门的计算器、专门的搜索工具。但如果直接给它一台功能完整的“虚拟电脑”,让它自己去探索如何使用,会发生什么?

ArXiv URL:http://arxiv.org/abs/2601.16206v1

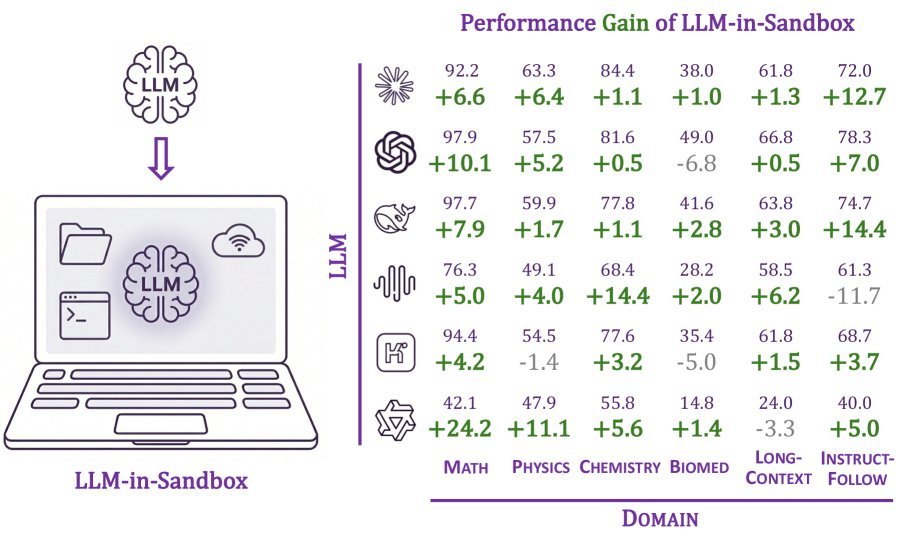

微软研究院联合中国人民大学、清华大学带来的最新研究 LLM-in-Sandbox 给出了惊人的答案:不需要额外的训练,强大的大模型就能自发地利用代码沙箱解决数学、物理、化学甚至生物医学等非代码领域的难题。 更令人兴奋的是,这种方法能将长文本任务的 Token 消耗量减少高达 $8\times$,并且通过一种巧妙的强化学习方法,还能反向提升模型原本的对话能力。

这篇论文不仅揭示了通用 Agent 智能的新路径,还开源了相应的 Python 包,为大模型的落地应用打开了新大门。

什么是 LLM-in-Sandbox?

目前的 Agent 框架通常针对特定任务设计复杂的工具链。然而,LLM-in-Sandbox 的核心理念是“大道至简”:它为 LLM 提供了一个基于 Docker 的 Ubuntu 环境,也就是一台“虚拟电脑”。

但这台电脑并没有预装成百上千个专用工具,而是只提供了三个最基础的元能力(Meta-Capabilities):

-

执行 Bash 命令 (\(execute_bash\)):这是计算机最通用的接口,可以安装软件、管理文件、运行程序。

-

文件编辑 (\(str_replace_editor\)):用于创建、查看和修改文件。

-

提交结果 (\(submit\)):告诉系统任务已完成。

如上图所示,这种设计极大地释放了模型的潜力。在没有任何额外微调的情况下,像 Claude-3.5-Sonnet 或 GPT-4 这样的强模型展现出了惊人的泛化能力。

例如,在遇到一个需要预测分子性质的化学问题时,模型发现自己没有相关知识,竟然自主地通过终端安装了 Java 环境,下载了专业的 OPSIN 库,将化学名称转换为分子结构,从而解决了问题。这种“缺什么装什么”的能力,正是通用智能的体现。

强模型如虎添翼,弱模型如何“开窍”?

研究团队发现了一个有趣的现象:虽然强模型(如 Claude, GPT-4)能直接玩转沙箱,但较弱的模型(如 Qwen3-4B)往往会在沙箱里“迷路”,不知道如何有效利用工具,甚至表现不如直接问它(Vanilla Mode)。

为了解决这个问题,论文提出了 LLM-in-Sandbox 强化学习(LLM-in-Sandbox-RL)。

这个方法的巧妙之处在于数据来源。通常训练 Agent 需要昂贵的专家轨迹数据,但研究人员发现,仅使用通用的非 Agent 数据(例如阅读理解任务),就能教会模型如何探索沙箱。

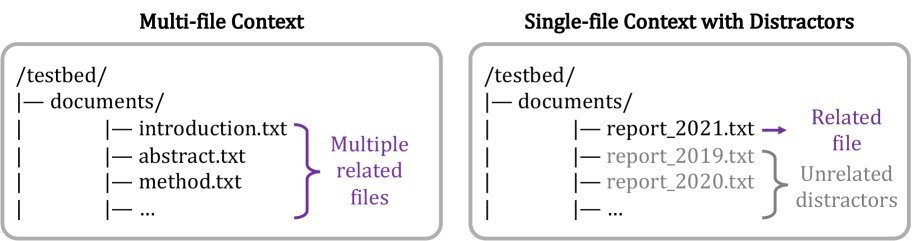

具体做法是:

-

将阅读材料(Context)作为文件放入沙箱(例如 \(/testbed/documents/\)),而不是直接塞进 Prompt。

-

要求模型通过读取文件、分析内容来回答问题。

-

使用基于结果的奖励机制(Outcome-based Rewards)进行强化学习。

这种训练迫使模型必须学会“与环境交互”才能获得信息。实验结果表明,经过 LLM-in-Sandbox-RL 训练后:

-

弱模型变强了:Qwen3-4B 在沙箱模式下的表现大幅提升,不再“胡乱操作”。

-

泛化能力爆发:虽然只在通用文本任务上训练,但模型在数学、代码、甚至物理任务上的表现都提升了。

-

反哺原生能力:最令人惊讶的是,这种在沙箱里的训练,竟然让模型在不使用沙箱时的直接对话能力也变强了!这表明模型学到的不仅仅是工具使用,更是通用的推理和规划能力。

长文本任务的“降维打击”

在处理长文本(Long Context)时,LLM-in-Sandbox 展现出了巨大的工程价值。

传统的 RAG 或长窗口模型需要将成千上万字的文档全部塞入 Context Window,这不仅昂贵,而且推理速度慢。而在 LLM-in-Sandbox 模式下,文档被作为文件存储在沙箱中。

模型不需要一次性“背诵”全文,而是像人类操作员一样:

-

使用 \(grep\) 或 \(ls\) 快速定位相关文件。

-

编写 Python 脚本提取关键信息。

-

只读取必要的片段。

实验数据显示,在处理 100K 长度的文档任务时,相比于直接 Prompting,LLM-in-Sandbox 将 Token 消耗从 100K 降低到了 13K,减少了近 $8\times$,同时保持甚至提升了准确率。这对于降低大模型落地成本具有决定性意义。

总结与展望

LLM-in-Sandbox 向我们展示了一个清晰的未来:通用的 Agent 智能不需要为每个任务定制复杂的工具链,只需要给大模型一个自由的、类似操作系统的环境。

这项研究不仅证明了“代码沙箱”是激发大模型通用智能的最佳练兵场,还提供了一套低成本的强化学习方案,让小模型也能具备 Agent 能力。随着该项目的开源,我们可以期待更多基于“虚拟电脑”的智能应用涌现,让 AI 真正成为能够自主解决复杂问题的数字助手。

论文链接与开源代码:目前该项目已作为 Python 包开源,支持 vLLM 和 SGLang 等主流推理后端,感兴趣的开发者可以尝试将自己的 LLM 放入这个“沙箱”中,看看它能进化出怎样的智能。