LLM Router: Prefill is All You Need

英伟达亮剑LLM路由:成本锐减74%,性能直追理论最优!

当面对一个复杂任务时,我们应该用GPT-4、Claude 3还是Llama 3?这是一个价值千金的问题。每个顶尖大模型都有自己的“绝活”,但在某些任务上也会“翻车”。如果有一个智能调度员,能为每个问题自动选择最擅长且最经济的模型,那该多好?

ArXiv URL:http://arxiv.org/abs/2603.20895v1

过去,人们尝试通过分析问题的“语义”来实现这一点,但这就像只看书名就判断一本书的好坏,往往不靠谱。现在,英伟达(NVIDIA)的研究人员提出了一个全新的思路:与其猜测,不如直接“偷看”模型的大脑!他们发现,决胜的关键信号,就隐藏在模型开始生成答案前的“预填充”(Prefill)阶段。

告别语义,拥抱“机制”

传统的LLM路由器大多依赖语义路由(semantic routing)。它们分析你提问的文本,试图将其匹配到最合适的模型。这种方法的致命弱点在于:语义相似不等于任务难度相似。一个看似简单的金融问题,可能需要极其复杂的推理,这是仅靠文本表面无法判断的。

英伟达的这篇论文《LLM Router: Prefill is All You Need》则开辟了一条新路:机制路由(mechanistic routing)。核心思想是,一个模型能否正确回答问题,其内部的激活状态(activations)在计算的最初阶段(即Prefill)就已经“泄露了天机”。

这些内部激活状态,就像模型在处理问题时的“脑电波”,蕴含着比问题本身丰富得多的信息。

核心创新一:编码器-目标解耦

这项研究最令人拍案叫绝的发现之一,是编码器-目标解耦(Encoder-Target Decoupling)。

你可能会想,要预测Claude模型会不会答对,最好的信号当然来自Claude自己吧?答案是:并非如此!

研究发现,使用一个完全不同的“外部”开源模型(如Qwen)作为编码器(Encoder),来分析和预测一个闭源目标(Target)模型(如Claude)的性能,效果竟然出奇地好,甚至超过了目标模型自身的信号。

这就像一位经验丰富的旁观者(编码器模型),通过观察棋手(目标模型)的开局落子,就能比棋手本人更准确地判断这盘棋的输赢。这使得我们能用一个轻量级的本地模型,去高效调度那些昂贵、不透明的闭源API,极具实用价值。

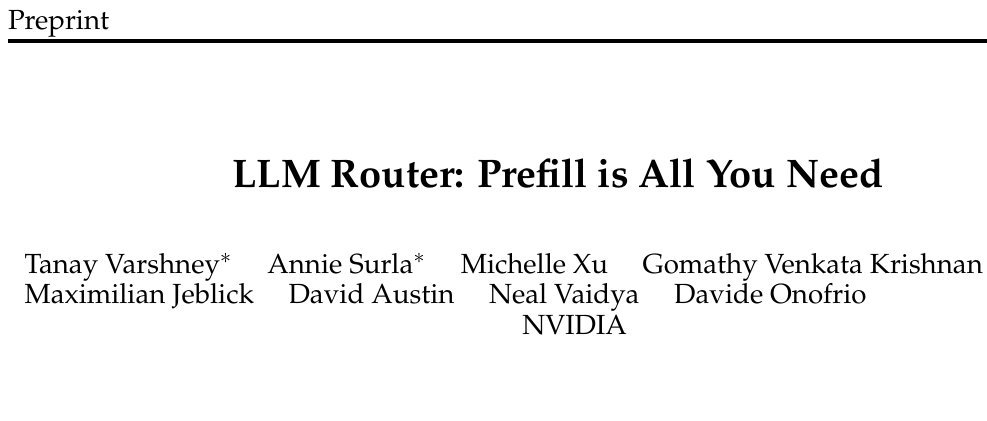

图1:LLM Router的两阶段架构:首先从编码器模型中提取Prefill信号,然后用一个小型网络(SharedTrunkNet)来预测各个目标模型的置信度。

核心创新二:用数学探针定位最佳信号

模型内部有那么多层,到底哪一层的“脑电波”最有用?过去的研究常常简单粗暴地选择最后一层。

本文引入了更科学的方法,使用费雪可分性(Fisher Separability, $J$)和有效维度(Effective Dimensionality, $d_{\text{eff}}$)等数学探针,来系统性地评估每一层激活状态的“信号质量”。

\[J=\frac{\ \mid \mathbf{\mu}\_{1}-\mathbf{\mu}\_{0}\ \mid ^{2}}{\mathrm{tr}(\Sigma\_{0})+\mathrm{tr}(\Sigma\_{1})}\]其中,$J$值衡量的是“正确”答案和“错误”答案两类激活状态在空间中的分离程度。$J$值越大,意味着该层的信号越清晰、越容易区分,也就越适合作为预测的依据。实验证明,通过$J$值选出的层,其预测效果远超传统方法。

SharedTrunkNet:更聪明的决策网络

基于以上发现,研究团队设计了一个名为 SharedTrunkNet 的路由架构。它能同时接收来自同一个编码器模型、针对不同目标模型的多个预测信号。

通过在一个共享的主干网络(Shared Trunk)中进行比较,SharedTrunkNet可以获得一种“跨模型上下文”,从而更准确地评估每个任务对不同模型的“相对难度”,最终做出最优选择。

惊人的实验效果:更省钱、更准确

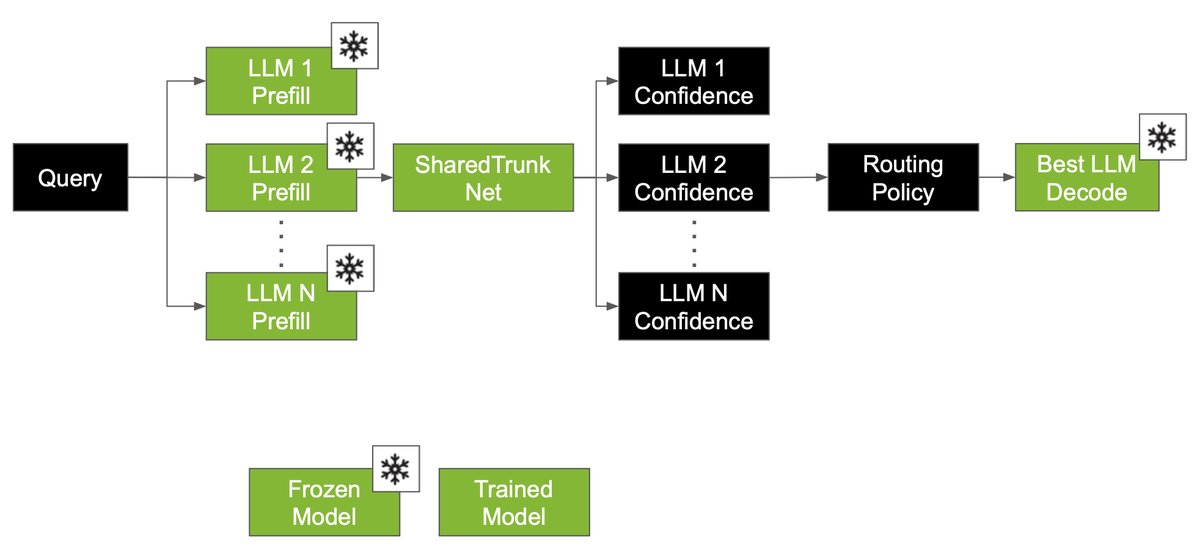

口说无凭,实验结果最能说明问题。研究人员在包含前沿模型(如GPT系列、Claude系列)和小型模型(7B-9B)的多个模型池中进行了全面评估。

结果显示,SharedTrunkNet的表现全面碾压了基于语义的路由方法。

图2:在前沿模型池上的原始成本-准确率曲线。蓝线(SharedTrunkNet)在所有成本点上都实现了比其他方法更高的准确率。

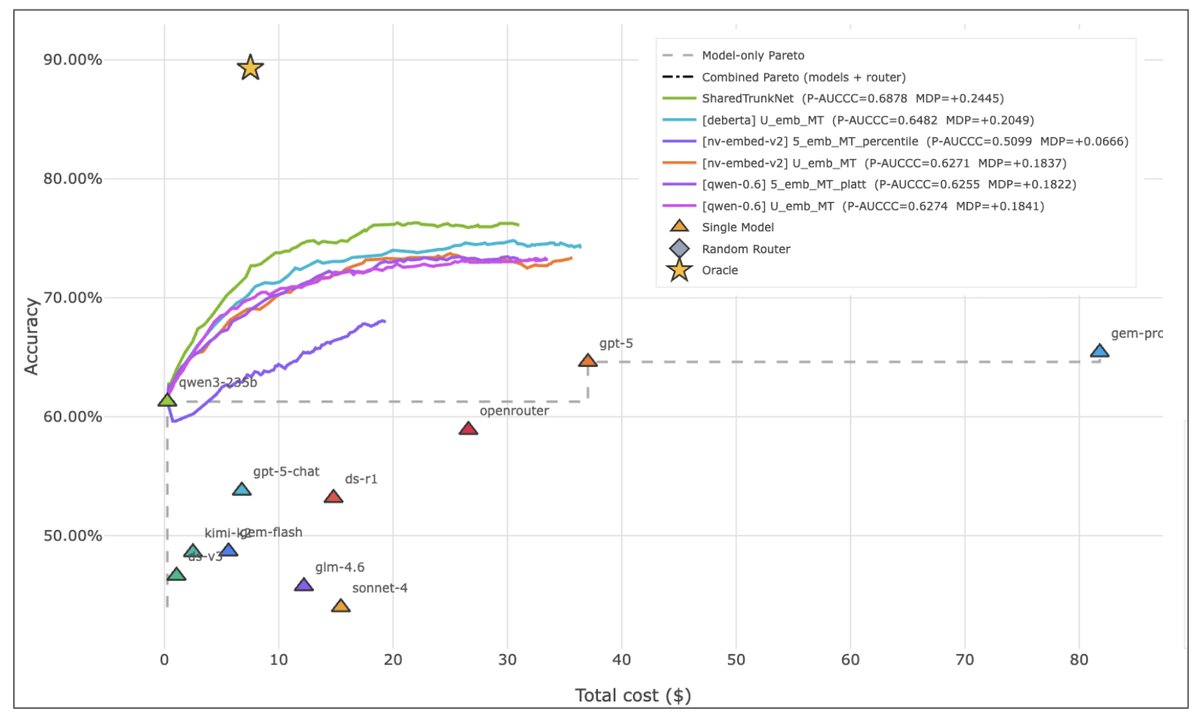

图3:归一化后的性能对比。目标是尽可能接近右上角的“Oracle”(理论最优)点。SharedTrunkNet(蓝色)的曲线最接近这个目标。

具体来说,SharedTrunkNet取得了以下亮眼成绩:

-

填补了45.58%的精度差距:它成功弥补了当前最强单个模型与“先知”(Oracle,即理论上完美的路由器)之间近一半的准确率鸿沟。

-

节省了74.31%的推理成本:相较于总是使用最昂贵的模型,该方法能在保证极高准确率的同时,大幅降低费用。

-

路由效能提升53.62%:在综合衡量成本和准确率的指标上,其表现远超静态选择模型的策略。

这些数据雄辩地证明,基于Prefill信号的机制路由,不仅在理论上更优越,在实践中也带来了实实在在的巨大收益。

总结与展望

这项来自英伟达的研究,为LLM协作系统(Multi-LLM Systems)的构建提供了一个全新的、更强大的范式。它告诉我们,理解和利用模型内部的运作机制,远比停留在表面的语义分析更有价值。

通过编码器-目标解耦和基于费雪可分性的层选择,该研究不仅提出了一种高效、低成本的路由方案,也为我们深入理解Transformer的内部几何结构提供了新的视角。

未来,一个由无数专用、通用、大型、小型LLM组成的智能网络,在这样一个“超级调度员”的指挥下协同工作,或许将是通往更强大、更经济的通用人工智能的关键一步。