PaCoRe: Learning to Scale Test-Time Compute with Parallel Coordinated Reasoning

8B模型超越GPT-5!PaCoRe:解锁200万Token推理算力的新范式

当前的大语言模型(LLM)存在一个显著的短板:推理能力被死死地限制在了上下文窗口(Context Window)里。一旦思维链(Chain-of-Thought)的长度填满了窗口,推理就必须停止。

ArXiv URL:http://arxiv.org/abs/2601.05593v1

但如果我们可以打破这个限制呢?

来自北京大学、阶跃星辰(StepFun)和清华大学的研究团队刚刚发布了一项重磅工作——PaCoRe。这项技术通过一种全新的“并行协同推理”架构,让一个仅有 8B参数 的模型,在HMMT 2025数学竞赛基准上达到了 94.5% 的准确率,一举超越了GPT-5(93.2%)。

它通过在推理阶段并行生成并协同处理高达 200万Token 的有效计算量,却完全不会撑爆模型的上下文窗口。这究竟是如何做到的?

告别“单线程”:从串行到并行协同

传统的提升推理能力的方法(如CoT)是线性的:模型一步接一步地思考,所有的中间步骤都堆积在同一个上下文窗口中。这就像一个人在解一道难题,草稿纸(上下文)写满了就没法继续了。

PaCoRe(Parallel Coordinated Reasoning)则完全不同。它不再依赖单一的深度搜索,而是转向了广度的协同探索。

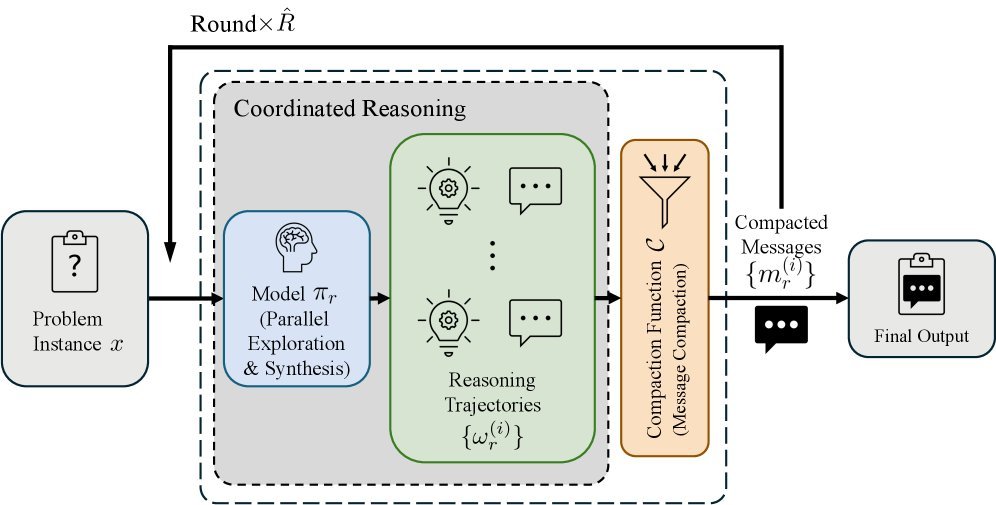

如上图所示,PaCoRe的推理过程像是一个高效的团队协作:

-

并行探索(Parallel Exploration):在每一轮推理中,模型同时启动多个并行的推理轨迹(Trajectories)。这相当于派出了几十个分身同时去试错。

-

消息压缩(Message Compaction):这是PaCoRe最精妙的一步。它不会把所有分身的废话都塞进下一轮,而是提取每个轨迹的“最终结论”,压缩成简短的“消息”(Message)。

-

协同合成(Synthesis):模型读取上一轮所有分身传回的压缩消息,综合这些线索,指导下一轮的探索。

通过这种“生成-压缩-协同”的循环,PaCoRe可以在固定大小的上下文窗口内,通过多轮迭代,累积出相当于 数百万Token 的有效推理计算量(Test-Time Compute, TTC)。

核心难点:从“独断专行”到“集思广益”

仅仅把并行的结果喂给模型是不够的。研究人员发现,普通的推理模型往往患有“推理唯我论”(Reasoning Solipsism):即使你给它提供了其他分支的高质量线索,它也倾向于忽略这些信息,坚持自己从头算一遍,导致计算资源的浪费。

为了解决这个问题,PaCoRe引入了大规模的、基于结果的 强化学习(Reinforcement Learning)。

这不仅仅是简单的“少数服从多数”投票(Majority Voting),而是训练模型掌握一种更高级的能力——推理合成(Reasoning Synthesis)。经过训练的PaCoRe模型学会了:

-

审查:仔细评估来自不同并行分支的相互冲突的证据。

-

调和:在矛盾的信息中找到合理的解释。

-

超越:综合各方线索,生成一个比任何单个分支都更优质的最终答案。

实验表明,经过这种训练的模型甚至能从全是错误信息的上下文中,“推导”出正确的解题思路,展现出了惊人的鲁棒性。

实验结果:8B模型的大逆袭

PaCoRe的效果在数学和代码任务上尤为显著。

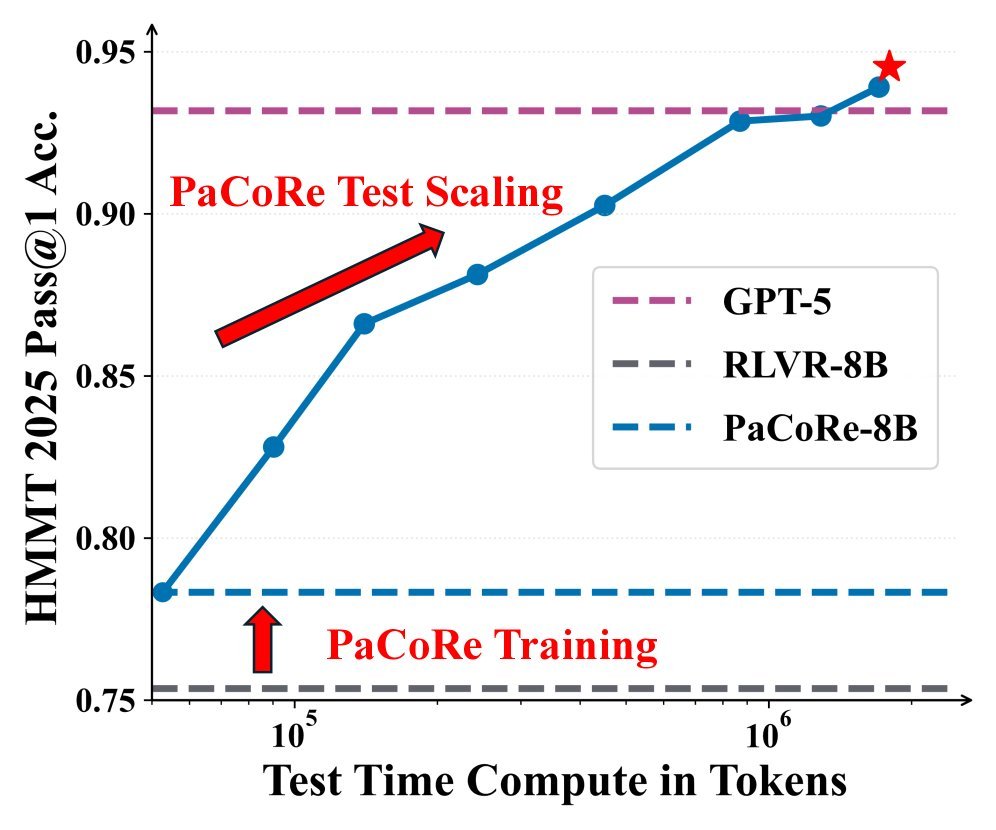

从上图左侧可以看到,在HMMT 2025基准测试中:

-

随着推理计算量(TTC)的增加(通过增加并行轨迹数和协同轮数),PaCoRe-8B的性能稳步提升。

-

最终,PaCoRe-8B 达到了 94.5% 的准确率,超过了 GPT-5 的 93.2%。

-

这证明了通过并行协同推理,小模型完全可以通过消耗更多的推理时算力来换取超越大模型的智能。

而在右侧的LiveCodeBench测试中,未经PaCoRe训练的模型(RLVR-8B)即使增加了计算量,性能也几乎没有提升(蓝线平直),说明它无法利用额外的信息。而PaCoRe-8B(红线)则随着计算量的增加,性能一路飙升,证明了“合成能力”的重要性。

总结与展望

PaCoRe不仅是一个具体的模型,更是一种通用的推理框架。它揭示了一个关键趋势:AI的未来不仅仅在于把模型做大(Pre-training Scaling),更在于如何在推理阶段更聪明地使用算力(Test-Time Scaling)。

通过解耦“推理量”与“上下文窗口”,PaCoRe让模型能够进行几乎无限的深度思考。目前,该团队已经开源了模型权重、训练数据和完整的推理流程,这无疑将加速社区在这一方向上的探索。

当一个8B模型学会了像人类团队一样“分工协作”和“开会总结”,它所爆发出的能量,足以让最顶尖的闭源模型感到压力。