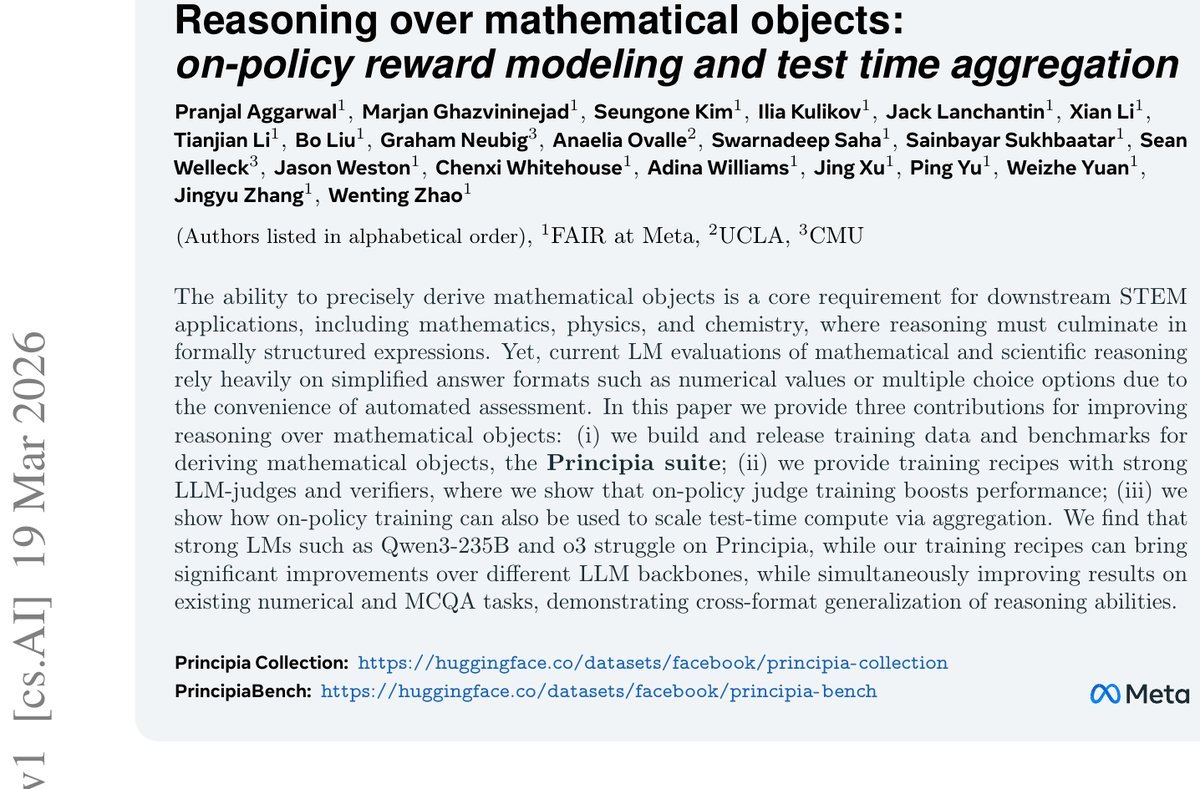

Reasoning over mathematical objects: on-policy reward modeling and test time aggregation

AI数学推理不再“偏科”:Principia让大模型精通复杂公式,性能提升18%!

大模型在数学竞赛中摘金夺银,但你有没有发现,它们给出的答案通常只是一个孤零零的数字或选择题选项?当面对真正需要推导矩阵、方程组或分段函数等复杂“数学对象”的科学问题时,即便是最前沿的模型也常常束手无策。

ArXiv URL:http://arxiv.org/abs/2603.18886v1

这正是当前大模型数学推理能力的一大短板。

来自CMU、Meta和UCLA的研究人员敏锐地洞察到这一问题。他们认为,仅依赖简单的答案格式来评估模型的推理能力,会严重高估它们的真实水平。为此,他们推出了一整套解决方案,旨在让AI学会进行真正意义上的数学和科学推理。

这项研究的核心贡献可以概括为三点:

-

Principia基准套件:一个专为复杂数学对象推理而生的“健身房”,包含全新的训练数据集和评测基准。

-

RLLM训练方法:一种新颖的“在策略”(on-policy)奖励模型训练方法,让AI裁判更懂AI选手。

-

ParaGator推理策略:一种在测试时聚合多个并行解法的技巧,进一步提升最终答案的准确性。

Principia:为复杂数学推理量身打造的“健身房”

当前AI社区缺乏专门用于训练和评估复杂数学对象推导能力的数据。这主要是因为,验证一个矩阵或一个函数是否正确,远比检查一个数字答案要困难得多。

为此,研究团队构建了 Principia 套件,它包含两个核心部分:

PrincipiaBench:一个全新的评测基准。它从RealMath、Physics等多个高难度数据集中筛选出2558个问题,这些问题都要求模型生成复杂的数学对象作为答案。实验表明,这个基准极具挑战性,即使是像Qwen3-235B这样的顶级模型也感到吃力。

Principia Collection:一个包含24.8万个合成问题的海量训练数据集。这些问题源自数学和物理学的研究生级别分类体系,答案覆盖了方程、不等式、矩阵、分段函数等六种复杂的数学对象类型。

通过在这个“健身房”中进行强化学习训练,多个基础模型在PrincipiaBench上的平均性能提升了7.22%到18.35%之多!

验证难题:为何需要“模型裁判”?

如何判断模型生成的复杂公式(如 $f_{UV}(u, v) = \frac{1}{2\pi(v^2 + 1)} e^{-u/2}$)是否与标准答案等价?

传统的基于规则的验证工具(如Python的Sympy库)在这种场景下显得非常脆弱。它们常常因为符号顺序、常数写法或LaTeX命令的微小差异而误判。

研究团队发现,使用一个强大的语言模型(如o3)作为“裁判”(Model-based Verifier),通过精心设计的提示词来判断两个数学表达式是否等价,效果要好得多。

为了验证“模型裁判”的可靠性,他们还创建了 Principia VerifyBench。结果显示,强大的模型裁判在判断复杂数学对象等价性方面,远胜于传统的规则验证器。

如上图所示,当训练数据(Principia Collection)包含复杂数学对象时,使用强大的模型裁判(GPT-OSS-120B)进行训练,模型性能从13.31飙升至31.80。而使用规则验证器(math-verify)的提升则非常有限,一个稍有偏差的验证器甚至会导致性能下降。

这证明了:对于复杂的数学推理任务,一个高质量的模型裁判至关重要。

RLLM:统一的“在策略”奖励模型训练法

为了更有效地训练模型,研究团队提出了RLLM(Reinforcement Learning with a strong LM as a Reward Model),即使用一个强大的语言模型作为奖励模型进行强化学习。

这与传统的RLHF(依赖人类偏好)和RLVR(依赖规则验证)不同。RLLM的核心思想是,这个作为奖励模型的语言模型(LM-as-RM)本身也是通过强化学习训练出来的,并且是“在策略”(on-policy)训练的。

这意味着,奖励模型是根据当前正在优化的策略模型所生成的输出来进行训练和调整的。这使得“裁判”能够更好地理解“选手”的思路和潜在错误,从而给出更精准的奖励不止会算数!Meta发布Principia,LLM数学推理性能提升18%,攻克矩阵、函数难题

当今的大语言模型(LLM)在数学问答上似乎越来越强,但它们的“强大”是真的吗?仔细一看,你会发现大多数评测都局限于给出单个数值或从几个选项中做选择题。这种简化的评测方式,就像只让一个数学系学生做小学算术,远远无法体现其真正的推理能力。

真正的科学与工程问题,往往需要推导出复杂的数学对象(mathematical objects),比如矩阵、分段函数或一个完整的方程。现在,来自CMU、Meta和UCLA的研究者们正面解决了这个难题,他们不仅发布了一套全新的评-练-测“全家桶”——Principia,还提出了一种创新的训练方法,让LLM在处理复杂数学对象时性能最高提升了18.35%!

问题的核心:超越数值与选择题

目前主流的数学推理评测,如AIME或GPQA,之所以青睐数值和选择题,主要是因为自动评分非常方便。但这造成了一个巨大的盲区:我们无法准确评估模型处理复杂结构化表达式的能力。

例如,下面这个问题要求推导出一个包含复数求和的表达式,这显然不是一个简单的数值答案能概括的。

为了填补这一空白,该研究推出了Principia,它包含三个核心部分,旨在系统性地提升和评估LLM的复杂数学推理能力。

Principia三件套:评测、训练、再验证

1. PrincipiaBench:一块更硬的“试金石”

这是一个全新的评测基准,包含了2,558个需要推导复杂数学对象的问题。这些问题源自RealMath、Physics等多个高难度数据集,并经过严格筛选,确保每个问题都具有挑战性且定义清晰。

有趣的是,评测这类问题本身就是一个难题。传统的基于规则的验证器(如使用$Sympy$库)非常脆弱。比如,它可能无法识别 $ \frac{1}{2\pi(v^2+1)} $ 和 $ \frac{1}{2\pi}\cdot\frac{1}{1+v^2} $ 是等价的,仅仅因为写法不同。

研究者们发现,一个强大的LLM(如o3模型)作为“裁判”,通过提示词判断两个复杂表达式是否等价,其准确性远超传统方法。

2. Principia Collection:高质量的“陪练”

为了让模型学会这项新技能,研究者们构建了一个包含24.8万个合成问题的训练数据集——Principia Collection。这些问题覆盖了数学和物理学的研究生级别主题,答案均为六种复杂的数学对象:方程、不等式、区间、集合、矩阵和分段函数。

Principia Collection中的问题示例

实验结果令人振奋。在多个基础模型(如Qwen2.5-7B、OctoThinker-8B)上使用Principia Collection进行训练后,模型在PrincipiaBench上的平均性能提升了7.22%至18.35%!

在PrincipiaBench上,使用Principia Collection训练的模型(绿色)显著优于基线模型(蓝色)和其他方法。

更重要的是,这种能力的提升还泛化到了其他任务上。在传统的数值型(AIME 2024)和选择题型(GPQA-Diamond)评测中,性能也分别提升了7.5-17.5%和12.31-25.47%。这表明,学习处理复杂对象能从根本上增强模型的逻辑推理能力。

3. Principia VerifyBench:裁判的“资格考试”

为了确保LLM裁判的可靠性,研究者还建立了一个元评测基准(meta-evaluation benchmark)。它包含了一系列人类标注的判断,专门用来评估不同验证器(无论是基于规则还是基于模型)的准确性。

实验表明,一个强大的模型裁判(如GPT-OSS-120B)在判断复杂数学对象等价性时至关重要。使用不够精确的验证器进行强化学习训练,甚至可能导致模型性能下降。

在Principia Collection上训练时,使用强大的模型裁判(Model-based (GPT-OSS-120B))带来的性能提升远超规则裁判(Rule-based)。

RLLM:更聪明的“在线”奖励模型

这项研究的另一大亮点是一种名为RLLM(Reinforcement Learning with a strong LM as a Reward Model)的统一后训练框架。

传统的强化学习(RL)方法存在局限:

-

RLHF:依赖人类偏好训练的标量奖励模型(给一个分数),无法提供详细的推理反馈,容易被“奖励 hacking”。

-

RLVR:依赖可验证的正确答案,但这在许多复杂或开放性任务中难以获得。

RLLM则另辟蹊径,它使用一个强大的语言模型本身作为奖励模型(LM-as-RM),并且这个奖励模型是在线策略(on-policy)训练的。

RLLM框架示意图

简单来说,这意味着“裁判”模型(LM-as-RM)会根据“学生”模型(策略模型)在训练中生成的实时输出来不断调整自己的判断标准。这就像一位经验丰富的导师,能够针对学生的具体错误进行动态指导,而不是始终依赖一本固定的参考答案。

RLLM在可验证任务和不可验证任务上均优于传统RLHF和RLVR方法。

实验证明,RLLM无论是在可验证的数学任务(包括难以验证的复杂问题)还是在不可验证的指令遵循任务上,都取得了比RLHF和RLVR更优异的性能。

ParaGator:更高效的“并行思考”

最后,研究还提出了一种名为ParaGator的测试时优化方法。传统的“并行思考”(生成多个答案后择优)存在一个问题:模型在生成答案时并不知道它们后续会被聚合,导致生成方案可能缺乏多样性。

ParaGator通过一个统一的在线训练框架解决了这个问题。它在生成阶段鼓励模型产出多样互补的解(优化$pass@k$),在聚合阶段则专注于选出或合成最佳答案(优化$pass@1$)。这种端到端的协同训练,让“并行思考”变得更加高效。

结论

这项工作意义重大。它不仅指出了当前LLM数学能力评测的短板,还提供了一套行之有效的解决方案。Principia系列工具(PrincipiaBench、Principia Collection)为社区提供了一个更严谨的评测标准和高质量的训练资源,而RLLM框架则为训练更强大的推理模型开辟了一条新路。

这项研究表明,让LLM学会处理矩阵、函数等复杂数学对象,不仅是通往更高阶科学智能的必经之路,其训练过程本身也能反哺和提升模型在其他格式任务上的通用推理能力。未来,我们期待看到更多能够进行真正“深度思考”而非仅仅“计算”的AI模型出现。