The Evolution of Reranking Models in Information Retrieval: From Heuristic Methods to Large Language Models

RAG效果提升神器:重排序模型从BERT到LLM的硬核进化史

在构建 检索增强生成(Retrieval Augmented Generation, RAG)应用时,你是否遇到过这样的尴尬场景:明明知识库里有正确答案,但检索系统捞出来的Top-K文档里,关键信息却被淹没在无关噪音中,导致大模型(LLM)最终胡说八道?

ArXiv URL:http://arxiv.org/abs/2512.16236v1

这往往不是LLM的问题,而是检索精度的“最后一公里”出了岔子。解决这个问题的关键技术,就是 重排序(Reranking)。

今天我们要解读的这篇综述论文《The Evolution of Reranking Models in Information Retrieval: From Heuristic Methods to Large Language Models》,堪称重排序领域的“编年史”。它不仅梳理了从传统机器学习到深度学习,再到如今大模型时代的完整技术演进,还深入探讨了如何在RAG流水线中平衡“精度”与“速度”这对永恒的矛盾。

为什么重排序是RAG的“胜负手”?

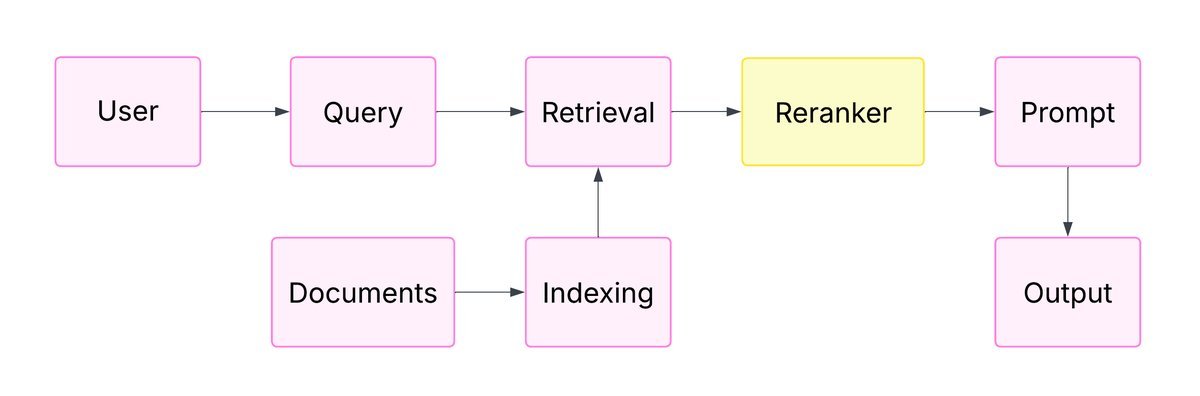

在一个典型的RAG系统中,为了保证召回率(Recall),第一阶段的检索(通常是向量检索或关键词检索)往往会捞出几十甚至上百个候选文档。然而,LLM的上下文窗口是昂贵的,且过长的上下文会引入“迷失中间”(Lost in the Middle)现象。

重排序模型的作用,就是充当一个精明的“过滤器”:它对粗排后的候选集进行精细的语义打分,把最相关的文档“推”到最前面,确保LLM看到的是真正的“干货”。

图1:RAG流程中的重排序(Reranking)模块位置示意图

第一阶段:深度学习重排序的崛起

论文首先回顾了基于深度学习的重排序模型,这部分是目前工业界落地的绝对主流。

1. BERT家族:Cross-Encoders的统治

最经典的架构莫过于基于BERT的 交叉编码器(Cross-Encoders)。与双塔模型(Bi-Encoders)将查询(Query)和文档(Document)分开编码不同,Cross-Encoder将两者拼接在一起输入模型,利用自注意力机制捕捉Token级别的细粒度交互。

虽然精度极高,但计算成本也大。为了解决效率问题,论文提到了 ColBERT 架构。它通过 延迟交互(Late Interaction)机制,保留了Token级别的嵌入,并通过 $MaxSim$(最大相似度)操作来计算分数:

\[S_{q,d} = \sum_{i \in q} \max_{j \in d} (E_{q_i} \cdot E_{d_j})\]这种方法允许文档表示预先计算,极大地降低了在线推理的延迟。

2. T5家族:生成式重排序

另一派则是基于 T5 的序列到序列(Seq2Seq)模型。有趣的是,这类模型将排序问题转化为了生成问题。

例如,模型被训练为针对“Query-Document”对生成“True”或“False”的标签,然后取生成“True”的概率作为相关性分数。更有趣的是 ListT5 等变体,它们尝试直接在解码器中对文档列表进行融合和排序,试图解决位置偏差问题。

第二阶段:效率为王——知识蒸馏

随着模型越来越大,推理成本成了拦路虎。论文重点讨论了 知识蒸馏(Knowledge Distillation)在重排序中的应用。

这不仅仅是简单的“大模型教小模型”。论文指出,现代的蒸馏策略已经进化为 推理感知(Reasoning-Aware)的蒸馏。

-

传统蒸馏:学生模型(Student)模仿教师模型(Teacher)输出的概率分布(Soft targets)。

-

进阶蒸馏:引入对比损失(Contrastive Loss),如LBKL损失,让学生模型在模仿老师的同时,保持一定的“独立思考”能力,避免过度模仿老师的错误。

-

推理蒸馏:不仅仅蒸馏分数,还蒸馏“理由”。让小模型学习大模型判断文档相关性的思维链(CoT),这对于处理复杂的、需要多跳推理的查询尤为重要。

第三阶段:LLM重排序——大模型的降维打击

当LLM进入战场,重排序的游戏规则再次改变。LLM不仅能打分,还能直接进行 列表级(Listwise)排序。

1. RankGPT与滑动窗口

以 RankGPT 为代表的方法,直接将一堆文档扔给ChatGPT等大模型,通过Prompt让它输出排序后的列表。

但在面对超长列表时,LLM的上下文窗口不够用怎么办?论文介绍了 滑动窗口(Sliding Window)策略:将长列表切分成多个小窗口,分别排序,然后再通过某种算法(如锦标赛排序)将结果合并。

2. 提示工程(Prompt Engineering)

你以为只是简单的“请给这些文档排序”吗?研究表明,Prompt的设计至关重要。

-

APE (Automatic Prompt Engineering):利用反馈机制自动优化Prompt。

-

软提示(Soft Prompts):将可学习的向量与原始文本嵌入拼接,作为LLM的输入,这种方法在特定领域的适应性上表现出色。

总结与展望

这篇综述不仅是一份技术清单,更揭示了重排序技术的发展脉络:从最初追求“特征工程”的传统LTR,到追求“语义交互”的深度学习,再到如今追求“理解与推理”的LLM时代。

对于正在构建RAG系统的开发者来说,论文传达了一个清晰的信号:没有最好的模型,只有最适合的权衡。

-

如果你追求极致的低延迟,经过蒸馏的 ColBERT 或小型 Cross-Encoder 依然是首选。

-

如果你处理的是复杂的推理型问答,且对延迟容忍度较高,引入 LLM进行重排序 或许能带来质的飞跃。

未来的重排序模型,很可能会走向两者的融合:用小模型做初筛,用大模型做精排,在计算成本与智能程度之间找到完美的平衡点。