What Makes Low-Bit Quantization-Aware Training Work for Reasoning LLMs? A Systematic Study

推理模型“瘦身”奇迹:2-bit量化下数学能力暴涨44%的技术解密

随着 DeepSeek-R1、OpenAI o1 等具备强大推理能力的模型相继问世,我们在惊叹于其解决复杂数学和代码问题能力的同时,也不得不面对一个尴尬的现实:推理模型太慢、太贵了。

ArXiv URL:http://arxiv.org/abs/2601.14888v1

这些模型通常依赖于长思维链(Chain-of-Thought),导致推理过程极其消耗 Token,部署成本居高不下。量化(Quantization)本是解决这一问题的“银弹”,但在极低比特(如 2-bit 或 3-bit)设置下,传统的训练后量化(Post-Training Quantization, PTQ)往往会让推理模型的智商“断崖式下跌”。

难道我们只能在“高昂成本”和“智障模型”之间二选一吗?

来自华为、新加坡国立大学和清华大学的研究团队带来了一项系统性研究,揭示了如何通过量化感知训练(Quantization-Aware Training, QAT)挽救低比特推理模型。他们提出的 Reasoning-QAT 工作流,在 Qwen3-0.6B 模型上,将 3-bit 量化下的 MATH-500 准确率相比 GPTQ 提升了惊人的 44.53%。

为什么推理模型一“量化”就变笨?

在深入解决方案之前,我们需要先看清问题的严重性。

传统的 PTQ 方法在通用语言任务上表现尚可,但在推理任务上却遭遇了滑铁卢。研究人员对比了非推理任务和推理任务在量化后的表现,发现了一个残酷的现象:

![[Uncaptioned image]](/images/2601.14888v1/r_vs_nonr_legned.jpg)

如上图所示,当使用 4-bit 量化时,性能损失还可接受;但一旦进入 3-bit 甚至更低的领域,推理任务(Reasoning)的准确率下降幅度远超非推理任务(Non-Reasoning)。这意味着,推理模型对精度的敏感度极高,简单的“剪裁”权重会直接破坏其逻辑链条。

既然“先训练后量化”(PTQ)走不通,研究人员将目光转向了“边量化边训练”(QAT)。但 QAT 并非简单的微调,对于推理模型而言,这其中有四个关键的技术抉择。

关键发现一:知识蒸馏 > 监督微调

在 QAT 过程中,我们应该用什么目标函数来训练模型?是像预训练那样用监督微调(Supervised Fine-Tuning, SFT),还是让老师模型来教学生模型的知识蒸馏(Knowledge Distillation, KD)?

研究发现,知识蒸馏(KD)是绝对的赢家。

-

SFT 的问题:SFT 使用硬标签(Hard Labels),在极低比特下,模型很难直接拟合这些确定的目标,导致准确率大幅下降(在 Qwen3-4B 上下降了 21.40%)。

-

KD 的优势:KD 让量化后的模型(学生)去模仿全精度模型(老师)的输出分布。这种软标签保留了更多的不确定性信息,提供了更平滑的梯度信号。

实验数据显示,无论原模型是基于 SFT 训练的还是基于 RL 训练的,KD 都能显著减少量化带来的精度损失。

关键发现二:不要从零开始,站在 PTQ 的肩膀上

QAT 的初始化非常关键。通常做法是直接加载全精度权重开始训练,或者使用简单的四舍五入(RTN)初始化。

但本研究指出,使用 PTQ(如 GPTQ)的结果作为 QAT 的初始化,效果最好。

这就好比让一个学生先预习(PTQ),虽然预习得不够完美,但比起一张白纸(随机或简单初始化),他能更快地跟上老师的节奏。GPTQ 初始化不仅让模型在训练初期就有较高的准确率,还能加快收敛速度,节省宝贵的训练算力。

关键发现三:强化学习(RL)需要“冷启动”

强化学习(如 DeepSeek-R1 背后的 GRPO 算法)是提升推理能力的核心。那么,我们能直接对 2-bit 的模型进行 RL 训练吗?

答案是:不能,除非你先帮它“热身”。

如果直接对低比特模型进行 RL 训练(Zero-RL QAT),模型会因为初始能力太差,无法生成正确的推理路径,导致拿不到奖励,最终训练崩塌(Collapse)。

研究团队提出了一种 “冷启动”策略:先通过 KD 恢复模型的基本能力,再进行 RL 训练。

-

KD 阶段:恢复采样能力,确保模型能生成有效的输出。

-

RL 阶段:进一步提升推理准确率,并抑制模型生成过长的废话(RL 能有效降低输出的熵,减少冗余)。

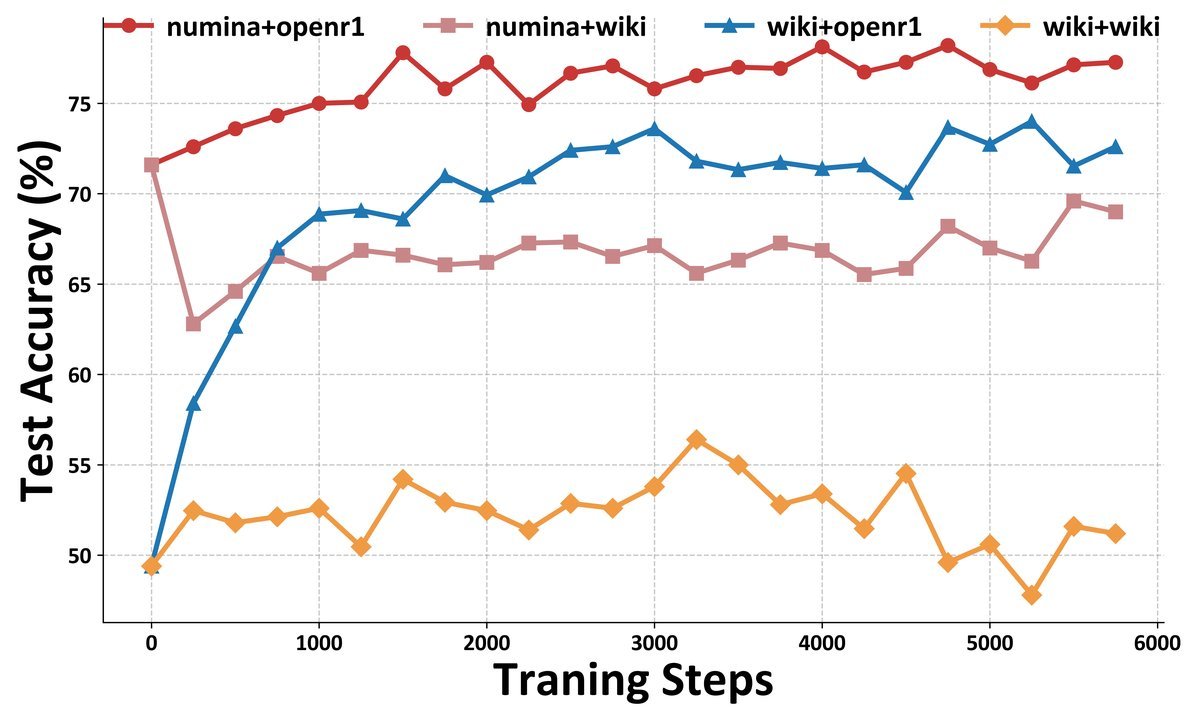

关键发现四:数据对齐是加速器

在 QAT 训练中,数据的选择也有讲究。研究发现,如果 PTQ 的校准数据(Calibration Data)与 QAT 的训练数据在领域上保持一致,模型的收敛速度会显著加快。

这意味着,如果你想量化一个数学模型,那么在 PTQ 阶段用来校准权重的少量数据,最好也是数学题,并且要与后续 QAT 训练用的数学数据集同源。

终极方案:Reasoning-QAT 工作流

基于以上四大发现,论文总结出了一套名为 Reasoning-QAT 的标准化工作流,专门用于挽救低比特推理模型:

-

PTQ 初始化:使用 GPTQ 等算法对模型进行初步量化,获取较好的初始权重。

-

KD 恢复:使用知识蒸馏对量化模型进行训练,快速恢复基础能力。

-

RL 进阶:在 KD 的基础上,使用强化学习(如 GRPO)进一步微调,激发模型的推理潜能。

总结

这项研究为大模型的“瘦身”提供了一份详尽的指南。它告诉我们,推理模型的量化不能简单粗暴,而需要精细的“调养”。

通过 KD 护航、PTQ 铺路、RL 冲刺 的组合拳,我们完全可以在保留强大推理能力的同时,将模型压缩到 2-bit 或 3-bit,让高性能推理在端侧设备或低成本服务器上运行成为可能。对于正在为部署 DeepSeek-R1 等模型而头疼的开发者来说,这无疑是一剂强心针。